Dans un écosystème numérique en perpétuelle mutation, la refonte ou la création d’une plateforme en ligne d’envergure requiert une approche hautement structurée et une anticipation constante des évolutions technologiques. Pour les directeurs des systèmes d’information, les directeurs techniques et l’ensemble des décideurs d’entreprise, le développement site web paris représente bien plus qu’une simple présence en ligne : c’est un levier de croissance stratégique fondamental qui exige des choix d’ingénierie extrêmement pointus. La capitale française, reconnue comme un véritable carrefour d’innovation technologique européen, concentre des exigences particulièrement fortes en matière de performance applicative, de sécurité des données sensibles et d’évolutivité des infrastructures serveurs. Aborder ce type de projet complexe implique d’analyser très minutieusement l’architecture logicielle retenue, les différents environnements de travail utilisés par les équipes de programmation et les protocoles de protection mis en œuvre contre les cybermenaces. Ce guide technique détaillé s’adresse spécifiquement aux entreprises de taille intermédiaire, aux grandes organisations et aux institutions locales qui souhaitent maîtriser les aspects techniques, budgétaires et opérationnels de la conception de plateformes digitales avancées. En comprenant précisément les fondements de l’ingénierie web moderne et les dynamiques spécifiques du marché francilien de la tech, les dirigeants peuvent ainsi sécuriser leurs investissements informatiques à long terme et garantir le déploiement d’une solution logicielle robuste, performante et intrinsèquement capable de s’adapter aux futurs défis de leur secteur d’activité, tout en minimisant la dette technique accumulée au fil des itérations.

Sommaire

Architecture technique et fondations logicielles pour les entreprises franciliennes

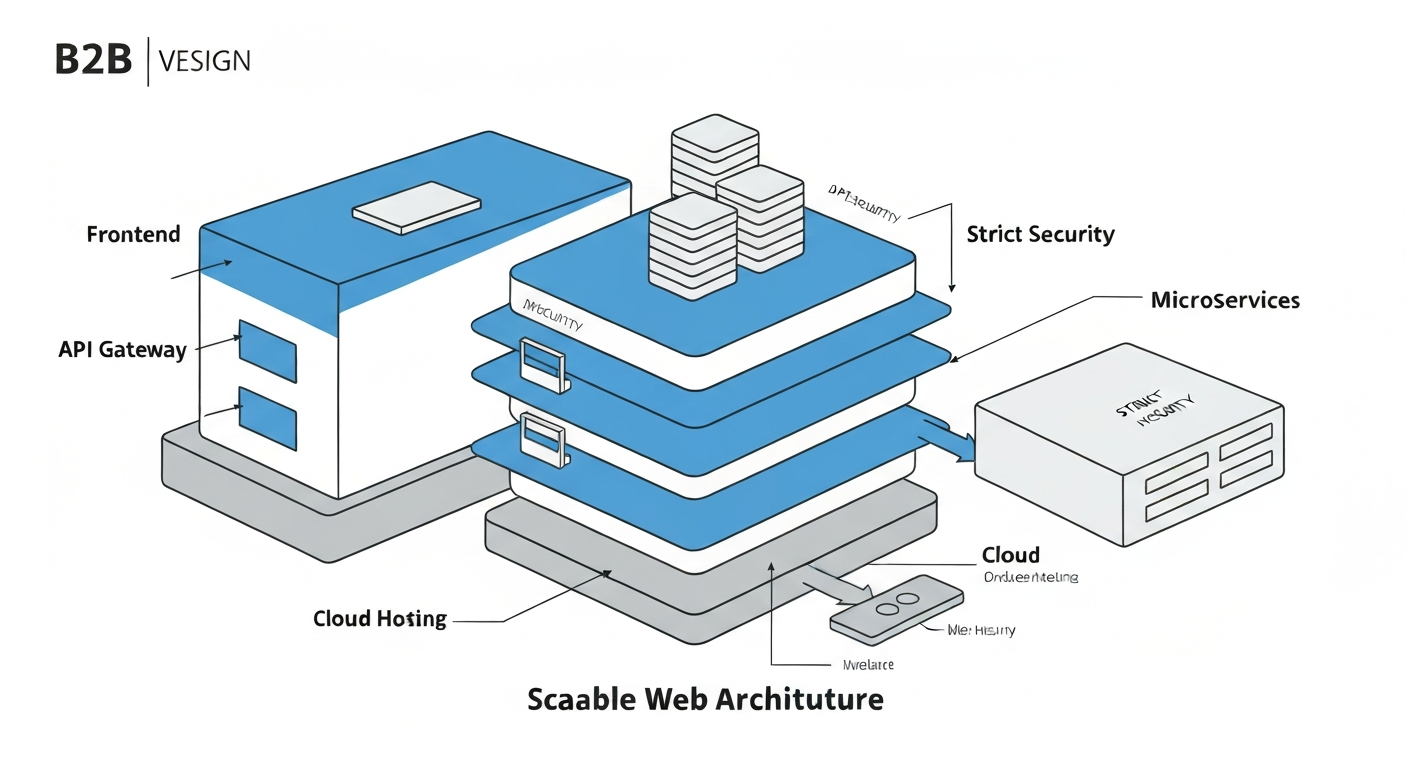

La réussite d’un projet technologique complexe repose avant tout sur la solidité, la résilience et la pertinence de son architecture logicielle sous-jacente. Face à la densification exponentielle des échanges de données et à l’évolution constante des attentes des utilisateurs en matière de réactivité, les infrastructures monolithiques traditionnelles montrent de plus en plus leurs limites opérationnelles. Les décideurs informatiques doivent aujourd’hui arbitrer de manière éclairée entre diverses approches architecturales, telles que le découplage fonctionnel, les microservices ou encore les architectures orientées événements. Cette décision d’ingénierie initiale conditionne non seulement la vélocité des déploiements futurs des nouvelles fonctionnalités, mais détermine également la capacité réelle de la plateforme à absorber des pics de charge très importants lors de campagnes spécifiques. Une infrastructure découplée, souvent désignée sous le terme d’architecture headless, permet par exemple de séparer strictement le traitement des données et la logique métier en arrière-plan de l’interface utilisateur affichée sur les différents terminaux. Cette méthode offre ainsi une flexibilité technologique inégalée pour intégrer de nouveaux canaux de diffusion, tels que des applications mobiles natives ou des objets connectés, sans jamais compromettre la stabilité du noyau central de l’application.

Dans le contexte économique et technologique actuel, la performance d’affichage et de traitement n’est plus une simple métrique technique isolée, mais un véritable indicateur clé de performance commerciale et d’expérience utilisateur. Selon une étude publiée par le cabinet de conseil Gartner (2023), l’optimisation rigoureuse des temps de réponse applicatifs et la refonte de l’architecture serveur permettent de réduire le taux de rebond de près de trente pour cent, tout en améliorant significativement les taux de conversion et le retour sur investissement global des écosystèmes digitaux. Les entreprises cherchant à moderniser leurs outils de production et de communication doivent donc impérativement intégrer, et ce dès la phase de conception logicielle, des mécanismes avancés de mise en cache, des réseaux de diffusion de contenu performants et des requêtes de bases de données parfaitement optimisées. La sélection du langage de programmation principal et du framework de développement joue également un rôle absolument déterminant dans cette équation technique. Les environnements modernes et robustes basés sur JavaScript, Python ou des solutions éprouvées comme PHP avec Symfony, offrent des écosystèmes extrêmement matures. Ces technologies sont par ailleurs soutenues par des communautés de développeurs particulièrement actives et d’importants acteurs industriels, ce qui garantit la pérennité du code source et facilite grandement la maintenance évolutive de l’application sur le très long terme.

Le processus de création applicative nécessite une méthodologie de gestion de projet extrêmement rigoureuse afin d’aligner en permanence les impératifs techniques avec les objectifs stratégiques globaux de l’organisation. L’adoption de cadres de travail agiles s’impose aujourd’hui comme un standard incontournable pour piloter ces chantiers informatiques complexes, permettant des itérations de développement rapides, des tests continus et une adaptation fluide aux retours des utilisateurs finaux et des parties prenantes. Cette approche itérative réduit drastiquement les risques d’échec inhérents aux développements informatiques monolithiques en validant chaque module fonctionnel de manière incrémentale. De plus, l’intégration continue et le déploiement continu deviennent des pratiques d’ingénierie indispensables pour automatiser les tests de non-régression, les analyses de qualité de code et garantir que chaque nouvelle ligne de code déployée en production respecte scrupuleusement les standards de qualité établis par la direction technique. Dans ce cadre de haute exigence, la collaboration étroite et décloisonnée entre les équipes de développement logiciel et les administrateurs systèmes permet d’optimiser l’utilisation des ressources d’hébergement cloud, qu’il s’agisse de la conteneurisation des applications avec des outils comme Docker, ou de l’orchestration complexe de services via des plateformes comme Kubernetes.

Afin de structurer efficacement et durablement cette démarche d’ingénierie logicielle, plusieurs critères fondamentaux doivent impérativement guider les choix stratégiques des directions des systèmes d’information :

- La scalabilité horizontale et verticale de l’infrastructure pour anticiper sereinement la croissance future du volume de données traitées et l’augmentation du trafic web.

- L’interopérabilité totale du nouveau système avec le système d’information patrimonial existant de l’entreprise, rendue possible grâce à des interfaces de programmation robustes et documentées.

- La maintenabilité exemplaire du code source, assurée par une documentation technique exhaustive, des tests automatisés et le respect absolu des normes de développement internationales.

- La portabilité technique des environnements de déploiement pour conserver une totale souveraineté sur les données et éviter la dépendance technologique excessive envers un fournisseur d’hébergement cloud unique.

La prise en compte rigoureuse de ces différents éléments structurels garantit la conception d’une plateforme numérique véritablement pérenne et évolutive. L’enjeu majeur pour les directions générales est de construire un actif numérique valorisable sur le long terme, capable de s’intégrer harmonieusement dans une stratégie omnicanale ambitieuse. Les responsables techniques doivent évaluer avec la plus grande attention le cycle de vie de chaque composant logiciel sélectionné, en privilégiant systématiquement les solutions open source reconnues ou les solutions propriétaires bénéficiant de feuilles de route transparentes et d’un support professionnel certifié. Cette anticipation technique méthodique permet d’éviter l’accumulation dangereuse de dette technique, un fléau souvent silencieux qui paralyse progressivement la capacité d’innovation des entreprises, ralentit les délais de mise sur le marché des nouvelles offres et alourdit considérablement les coûts opérationnels de maintenance au fil des années d’exploitation.

Enfin, la gouvernance des données et l’urbanisation du système d’information représentent un axe central dans la conception de l’architecture logicielle moderne. La cartographie précise des flux d’informations transitant par la plateforme web permet de définir les politiques de stockage, de rétention et d’archivage les plus adéquates selon la criticité de la donnée. Les décideurs doivent s’assurer que l’architecture sélectionnée facilite nativement la conformité aux exigences réglementaires strictes, notamment en matière de localisation physique des données sur le territoire européen et de gestion granulaire des consentements utilisateurs. La mise en place de bases de données distribuées, couplée à des solutions de cryptage à la volée, constitue une réponse technique proportionnée et professionnelle aux risques industriels actuels. En structurant intelligemment et rationnellement cette couche fondamentale de données, l’organisation se dote d’une capacité d’analyse décisionnelle largement supérieure, transformant ainsi la simple plateforme web en un véritable moteur d’intelligence d’affaires et de création de valeur pour l’ensemble des départements de l’entreprise.

Sécurité, conformité réglementaire et intégration logicielle avancée

La sécurité applicative est indéniablement devenue la priorité absolue et non négociable des directions des systèmes d’information dans tout projet de transformation numérique. Face à la sophistication croissante, à la fréquence et à l’automatisation des cyberattaques ciblant les entreprises, la protection des actifs numériques requiert l’adoption systématique d’une approche de sécurité par la conception. Cette méthodologie d’ingénierie stricte implique d’intégrer les protocoles de défense, de chiffrement et de surveillance dès les toutes premières phases d’architecture matérielle et logicielle, bien avant la première ligne de code. Les vulnérabilités web courantes, telles que les injections SQL, les failles de type cross-site scripting, les falsifications de requêtes intersites ou les défauts logiques d’authentification, doivent être systématiquement neutralisées. Cette neutralisation s’opère grâce à des audits de code réguliers, à des revues par les pairs et à l’utilisation en production de pare-feu applicatifs web hautement performants capables de filtrer le trafic malveillant en temps réel. La gestion centralisée des identités et des accès constitue également un pilier essentiel de cette stratégie défensive, nécessitant l’implémentation de systèmes d’authentification multifacteur obligatoires et de protocoles de délégation d’autorisation sécurisés pour protéger les interfaces d’administration critiques et prévenir toute fuite de données sensibles concernant les utilisateurs ou l’entreprise.

Outre la protection indispensable contre les menaces externes, la conformité réglementaire impose aux organisations des contraintes techniques particulièrement rigoureuses qui ne peuvent être ignorées. Le Règlement Général sur la Protection des Données exige des architectes et des concepteurs logiciels qu’ils déploient des mécanismes de chiffrement asymétrique et symétrique robustes, tant pour les données au repos stockées dans les bases de données que pour celles en transit sur les réseaux. L’anonymisation irréversible et la pseudonymisation des informations à caractère personnel doivent être gérées de manière native par le cœur de l’application pour limiter les risques en cas d’intrusion. Les décideurs informatiques doivent scrupuleusement veiller à ce que l’infrastructure d’hébergement de la solution réponde aux standards internationaux de sécurité les plus exigeants, tels que la certification ISO 27001 ou la qualification SecNumCloud pour les acteurs français, afin de garantir l’intégrité, la stricte confidentialité et la haute disponibilité des services en toute circonstance. Une cartographie claire, documentée et régulièrement mise à jour des traitements de données facilite non seulement la mise en conformité juridique lors des contrôles, mais renforce également le capital confiance indispensable auprès des utilisateurs finaux et des partenaires commerciaux de l’organisation.

L’interconnexion sécurisée des actifs numériques avec l’ensemble du système d’information existant est le véritable moteur de la transformation digitale des organisations modernes.

Emma, Agence Peach

L’intégration technique et sémantique de la nouvelle plateforme au sein du système d’information global de l’entreprise est une étape d’ingénierie cruciale qui détermine in fine son efficacité opérationnelle et son adoption par les équipes métiers. L’approche architecturale privilégiée par les experts du secteur repose sur la conception et l’utilisation d’interfaces de programmation d’applications, communément appelées API, qui permettent une communication fluide, bidirectionnelle et parfaitement standardisée entre le site web et la myriade de logiciels tiers utilisés par l’entreprise. Que ce soit pour synchroniser des données financières avec un progiciel de gestion intégré, alimenter un outil de gestion de la relation client de pointe, ou s’interfacer avec une plateforme complexe de gestion des ressources humaines, l’architecture orientée services offre une agilité fonctionnelle maximale. Cette modularité technologique garantit formellement que chaque composant du système d’information peut évoluer, être mis à jour ou même être totalement remplacé indépendamment des autres briques, réduisant ainsi drastiquement les risques de blocage technique et facilitant l’adoption de nouvelles solutions logicielles innovantes au rythme précis des besoins opérationnels des différents services de l’entreprise.

L’orchestration millimétrée de ces échanges massifs de données nécessite une attention architecturale toute particulière concernant la gestion des erreurs de communication, la tolérance aux pannes et la résilience globale du système informatique. En cas de défaillance momentanée ou de latence excessive d’un service logiciel tiers, la plateforme web doit être techniquement capable de maintenir ses fonctionnalités essentielles accessibles aux utilisateurs grâce à des mécanismes d’ingénierie de dégradation gracieuse. L’utilisation avancée de files d’attente de messages inter-applicatifs et de systèmes de traitement asynchrone permet d’absorber efficacement les pics soudains de sollicitation sans jamais saturer ou faire s’effondrer les serveurs principaux. Parallèlement, la mise en œuvre d’une observabilité technique complète, via des outils de supervision algorithmique avancés et des plateformes de gestion centralisée des journaux d’événements, offre aux équipes d’exploitation informatique une visibilité en temps réel, claire et exploitable sur la santé globale de l’infrastructure logicielle et matérielle. Ces tableaux de bord techniques de haut niveau sont absolument indispensables pour diagnostiquer rapidement les anomalies complexes, anticiper les goulots d’étranglement et garantir un taux de disponibilité optimal, répondant ainsi parfaitement aux exigences strictes de continuité de service des entreprises modernes évoluant dans des environnements hautement concurrentiels.

Finalement, l’évolutivité capacitaire et fonctionnelle de la solution logicielle ne se limite pas uniquement à sa dimension purement technique, mais englobe également, et surtout, sa capacité intrinsèque à soutenir de manière proactive l’innovation métier au sein de l’organisation. Les plateformes web conçues sur des bases technologiques parfaitement saines et documentées permettent aux équipes de déployer très rapidement de nouvelles fonctionnalités différenciantes, telles que l’intégration fluide d’algorithmes d’intelligence artificielle pour la recommandation de produits, la personnalisation dynamique des parcours utilisateurs complexes ou l’automatisation intelligente de certains processus internes chronophages. Les directeurs techniques et les responsables de l’innovation disposent ainsi d’un outil technologique puissant, totalement aligné sur la stratégie globale de développement de l’entreprise, et capable de générer un avantage concurrentiel tangible et décisif sur leur marché. L’investissement financier et humain initial dans une architecture web véritablement robuste, sécurisée selon l’état de l’art et hautement interopérable se traduit inévitablement par une réduction significative des coûts de maintenance corrective à moyen terme et par une augmentation spectaculaire de l’efficacité opérationnelle globale de l’organisation tout entière.

FAQ – développement site web paris

Question : Quelles sont les architectures technologiques à privilégier pour garantir la performance d’une plateforme d’entreprise complexe ? La sélection technologique dépend intimement des contraintes de charge et des objectifs métier spécifiques du projet. Toutefois, dans une démarche d’ingénierie moderne, l’adoption d’une architecture découplée, séparant le traitement backend de l’affichage frontend via des API RESTful ou GraphQL, est très fortement recommandée. L’utilisation de frameworks JavaScript avancés côté client, couplés à une architecture de microservices évolutive et à des bases de données relationnelles ou NoSQL finement optimisées, permet de construire des systèmes hautement réactifs. De plus, l’intégration de réseaux de diffusion de contenu performants et de solutions de mise en cache en mémoire côté serveur s’avère indispensable pour assurer des temps de réponse minimaux et constants, même lors de très fortes sollicitations simultanées.

Question : Comment s’assurer de la sécurité absolue des données sensibles lors de la conception du système informatique ? La sécurité par la conception demeure la seule méthodologie de référence fiable pour les infrastructures critiques. Elle implique le chiffrement systématique des données sensibles au repos et en transit via des algorithmes cryptographiques robustes, l’implémentation de processus d’authentification forte à multiples facteurs, et la sécurisation stricte des interfaces de programmation via des passerelles API dédiées. L’exécution de tests d’intrusion réguliers, l’automatisation des audits de dépendances logicielles et la configuration experte de pare-feu applicatifs web sont des mesures de protection nécessaires pour se prémunir proactivement contre les vulnérabilités du Top 10 OWASP et garantir une conformité totale aux normes réglementaires européennes en vigueur, telles que le RGPD.

Question : Qu’est-ce qu’une approche orientée services et quel est son intérêt stratégique pour la gouvernance du système d’information ? Une architecture orientée services, ou son évolution vers les microservices, fragmente une application monolithique imposante en une suite de petits services logiciels autonomes, spécialisés et indépendants. Chaque service exécute un processus métier unique et communique avec les autres par le biais d’interfaces de programmation légères. L’intérêt stratégique majeur pour les directions informatiques réside dans la flexibilité organisationnelle et technique qu’elle procure. Cette approche permet en effet aux différentes équipes d’ingénierie de développer, de tester, de déployer et de mettre à l’échelle des services spécifiques de manière totalement indépendante. Elle accélère considérablement le cycle de livraison des nouvelles fonctionnalités métier tout en isolant efficacement les défaillances techniques éventuelles, augmentant ainsi drastiquement la résilience globale du système d’information de l’entreprise.

En conclusion, l’élaboration d’une infrastructure numérique robuste et évolutive exige indéniablement une vision stratégique très claire ainsi qu’une maîtrise technique approfondie des standards technologiques les plus actuels. Qu’il s’agisse des impératifs de cybersécurité, de l’évolutivité des bases de données ou de l’interopérabilité des systèmes logiciels, chaque décision architecturale a un impact mesurable et direct sur la performance commerciale et opérationnelle à long terme de l’organisation. Pour les décideurs techniques, les directeurs des systèmes d’information et les dirigeants d’entreprise qui souhaitent concrétiser leurs ambitions numériques avec un niveau d’exigence et de qualité maximal, piloter avec rigueur un projet de développement site web paris implique impérativement de s’entourer d’experts de l’ingénierie logicielle pour garantir un déploiement sécurisé, pérenne et parfaitement aligné sur les enjeux de croissance de l’entreprise.

Responsable communication et marketing digital chez Agence Peach, Emma accompagne les entreprises dans la définition et la mise en œuvre de stratégies performantes, mêlant créativité et efficacité. Forte de plus de 15 ans d’expérience, elle a piloté des projets digitaux pour des secteurs variés — du BTP au luxe — en plaçant toujours le ROI et l’impact client au cœur de ses actions.